UIUC обнаружила новую угрозу под названием «приседание с навыками»

1 минута на чтение

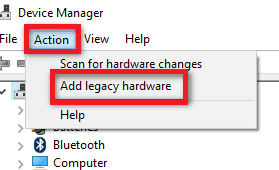

Amazon Echo

Мир меняется, и в современную эпоху мы с каждым днем все больше полагаемся на наши устройства Интернета вещей. Но эта уверенность может стоить нам всего, она может позволить кому-то украсть нашу личность, банковскую информацию, историю болезни и многое другое.

Amazon Alexa критиковали за наличие ряда недостатков безопасности, но Amazon быстро их исправил. Однако этот новый недостаток безопасности может вообще не иметь исправления. И это может быть самой опасной угрозой безопасности.

Согласно исследованию Исследование, проведенное Университетом Иллинойса в Урбана-Шампейн (UIUC), позволило использовать особенности Amazon Alexa с помощью голосовых команд для перенаправления пользователей на вредоносные веб-сайты. Хакеры нацелены на лазейки в алгоритмах машинного обучения для доступа к частной информации.

Метод, называемый «сквоттинг навыков», был разработан исследователями Иллинойского университета в Урбане-Шампейне и является успешным методом обмана Amazon Alexa для перенаправления пользователей на вредоносные платформы с помощью голосовых команд на устройствах Amazon Echo.

Многие пользователи часто неправильно произносят слова, что часто приводит к ошибкам интерпретации Alexa, речевого движка, на котором работает Amazon Echo. Исследователи использовали 11 460 образцов речи из слов английского языка, на которых говорят американцы.

Затем они изучили, где Алекса неверно интерпретирует голосовые команды, как часто она это делает и почему. Они смогли обнаружить, что определенные неверные толкования происходят регулярно.

Таким образом, используя «сквоттинг», хакер может использовать эти систематические ошибки, чтобы направлять пользователей Amazon Echo к вредоносным приложениям и веб-сайтам и подвергать риску их личную информацию. Этот метод можно использовать для определенных демографических групп, особенно тех, кто не владеет английским языком.

В варианте атаки, который мы называем приседанием с навыком копья, мы также демонстрируем, что эта атака может быть нацелена на определенные демографические группы. В заключение мы обсудим последствия ошибок интерпретации речи для безопасности, контрмеры и будущую работу.

Проблема может быть нелегкой, поскольку она зависит от тех самых принципов машинного обучения, на которых построены Alexa и другие машины AI. Amazon утверждает, что у нее есть меры для решения этой проблемы, но исследования Университета Иллинойса говорят об обратном.

Они утверждают, что это будет нелегко и может привести к серьезным проблемам в будущем.

Теги Алекса Amazon